- Soluciones

-

SAP Business One

Addons: SAP Business One

Consultoría: SAP S/4 HanaETL: Pentaho PDI / Apache Airflow

Data visualization Power BI / Superset

Data lake: Druid / Kafka

Machine learning: Scikit-learn / Tensorflow![]()

-

- Formación

- Curie Platform

- Partners

- Nosotros

- Recursos

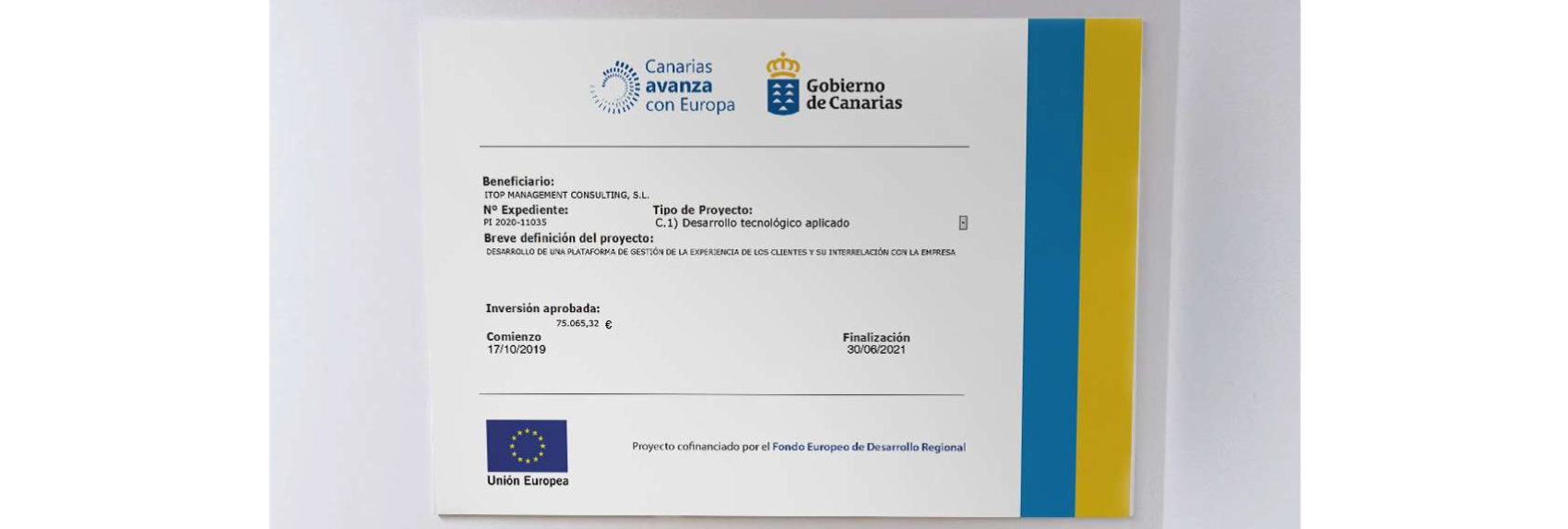

- Subvenciones

- Blog

- Contacto

Consulting

Mi nombre es Neil e implemento y desarrollo las soluciones tecnológicas líderes del mercado para lograr la transformación digital de tu empresa y mejorar la satisfacción de tus clientes. Entre nuestras soluciones destaca SAP Business One, del cual somos Partner Oficial desde 2006. Silver Partner en colaboración con Firsap.

Academy

Mi nombre es Albus y mi trabajo es instruir en aquellos productos tecnológicos que dominamos, como SAP, Pentaho o Moodle, soluciones tecnológicas como CRM, además de cursos sobre gestión del Negocio. Todo ello para aprender las competencias digitales más demandadas del mundo laboral, y que forman parte de las herramientas clave que toda empresa debería tener para lograr ser más competitiva, productiva y eficiente.

Curie Platform

Conocimiento y experiencia en tecnología y negocio

Una combinación perfecta de equipo, metodología, valores y colaboradores para ayudarte a conseguir los resultados que deseas para tu empresa.

¿Por qué elegirnos?

Contamos con una amplia experiencia en el sector y con una cartera de clientes nacionales e internacionales que nos avala.

+15

Años de Experiencia en Tecnología y Negocio

+500

Proyectos a clientes de todos los sectores

Espacio de Coworking / Aulas de Formación en Tenerife

¿Quieres compartir Espacio de Trabajo con nosotros o alquilar un Aula de Formación?

Artículos más recientes

Síguenos en nuestras redes sociales

Aviso Legal | Política de Privacidad | Política de Cookies

Itop Consulting © 2023